一种基于多尺度特征融合的单目深度估计方法

1.本发明属于三维场景感知领域,涉及一种基于多尺度特征融合的单目深度估计方法。

背景技术:

2.目前主流的单目深度估计方法分为无监督学习方法和有监督学习方法。无监督学习方法不需要采集真实的深度标签,训练时利用原图像和目标图像构成的立体图像对,首先利用编码器预测原图像的深度图,然后用解码器结合目标图片和预测的深度图重构原图,将重构的图片与原图对比计算损失。有监督学习方法是目前最流行的方法之一,通常利用深度相机或激光雷达采集深度标签,把图像深度估计作为回归任务或者是分类任务进行处理。大多数单目深度估计模型的编码网络由于特征提取不充分及特征提取阶段会丢失空间结构信息,并且由于实际场景结构复杂,普通的局部卷积模块难以考虑特征上下文之间的空间结构关系,造成估计深度图尺度模糊和失真的现象发生。针对这个问题,文献“chen等人,structure

‑

aware residual pyramid network for monocular depth estimation.in the international joint conference on artificial intelligence(ijcai).2019”提出利用残差金字塔网络构建了多尺度特征融合模块,其通过提取不同尺度的特征,获取结构层次更加明显的深度图,虽然该网络结构的设计能够大幅度的提高图像深度估计的精度,但是其网络模型复杂,计算开销大。文献“chen等人,attention

‑

based context aggregation network for monocular depth estimation.2019”使用基于注意力的聚合网络来捕获连续的上下文信息,并集成图像级和像素级上下文信息,但是并不能在多个尺度上的特征之间进行上下文信息的捕获以及空间信息的交互。

3.综上所述,目前在单目深度估计技术领域存在的问题是:1)在基于深度学习的图像深度估计领域,网络结构大多数采用的是编解码结构,编码网络在进行特征提取阶段会造成特征提取不充分、空间信息丢失等问题,导致网络难以学习图像中的一些细节信息。2)解码网络在对高维的语义特征进行不断的上采样过程中会丢失部分图像特征,导致深度图重建的效果差,不利于细粒度深度图的预测。3)单目深度估计面临的实际场景结构复杂,如果不有效的考虑场景中的空间结构关系,会造成估计的深度图精度不高。

技术实现要素:

4.有鉴于此,本发明的目的在于提供一种基于多尺度特征融合的单目深度估计方法,针对单目深度估计编码网络特征提取不充分、特征提取阶段容易丢失空间信息导致的网络难以学习更多的细节信息,引入了non

‑

local模块,在改进non

‑

local的同时构建了基于注意力机制的多尺度特征融合模块。在解码网络中,采用空洞空间金字塔池化模块中的空洞卷积弥补普通局部卷积模块感受野不足,并且极大的解决了深度图重建过程中由于上采样造成的图像特征丢失等问题,提高单目深度估计的精度,解决深度图尺度模糊及失真等系列问题。

5.为达到上述目的,本发明提供如下技术方案:

6.一种基于多尺度特征融合的单目深度估计方法,包括以下步骤:

7.s1:引入non

‑

local注意力机制,构造混合的归一化函数;

8.s2:在特征提取网络的本层特征、深层特征和浅层特征之间引入注意力机制,计算特征图上特征之间的关联信息矩阵;

9.s3:构建多尺度特征融合模块;

10.s4:在解码网络引入空洞空间金字塔池化模块,扩大卷积的感受野,迫使网络学习更多的局部细节信息。

11.进一步,所述步骤s1包括:

12.在non

‑

local的基础上,构造混合的softmox层作为归一化函数,归一化函数的计算公式如下:

[0013][0014][0015]

其中是第n个部分的相似度得分,i是特征图上的当前像素点,j是特征图上的所有像素点,π

n

表示第n个聚合权重,n表示特征图划分的数量,w

n

是一个网络训练中可学习的线性向量,是对应于特征图x上每个区域k

j

的算数均值。

[0016]

进一步,所述步骤s2具体包括以下步骤:

[0017]

s21:通过自转换,利用特征图上的其它特征点k

j

来对当前特征点q

i

进行关系建模,计算公式如下:

[0018][0019][0020]

其中,w

i,j

表示空间注意力图,f

mos

(

·

)表示归一化函数,q

i,n

表示索引,k

j,n

表示键,表示逐元素相乘,表示自转换后的特征图,v

j

表示值;

[0021]

s22:通过自上而下的特征转换,利用高维的语义信息对低维特征的上下文信息进行建模,计算公式如下:

[0022]

w

i,j

=f

mos

(f

eud

(q

i,n

,k

j,n

))

[0023][0024]

式中,f

eud

(

·

)表示特征图上两个像素点之间的欧式距离;

[0025]

s23:通过自下而上的特征转换,在不同尺度的特征图通道之间进行相关信息建模,具体的计算公式如下:

[0026]

w=gap(k)

[0027]

q

att

=f

att

(q,w)

[0028]

v

dow

=f

sconv

(v)

[0029]

[0030]

其中,w表示通道注意力图,gap表示全局平均池化,k表示网络浅层特征图的键,q

att

表示经过通道注意力加权后的特征,f

att

(

·

)代表外积函数,q表示网络深层特征图的索引,v

dow

表示下采样后的特征图,f

sconv

(

·

)是带步长的3

×

3卷积,v表示网络浅层特征图的值,表示经过自下而上转换的特征图,f

conv

(

·

)是用来细化的3

×

3卷积,f

add

(

·

)表示两个特征图进行逐元素相加之后再次通过3

×

3卷积处理。

[0031]

进一步,所述步骤s3中,对编码网络的中间4层特征分别进行步骤s2中的三种特征转换,得到多个增强后的高级特征,然后对增强后的特征按尺度进行特征重排,将相同大小的特征与编码网络上的原特征进行级联,最后通过一个3

×

3卷积将增强后特征的通道维度恢复到输入时的相同维度。

[0032]

进一步,所述步骤s4具体包括以下步骤:

[0033]

s41:通过在不同分辨率大小的特征图之间交叉嵌入多个空洞空间金字塔池化模块,从而捕获具有极大感受野的特征金字塔信息,以此来补偿上采样过程中丢失的特征信息;

[0034]

s42:基于上采样的方法选择参数可学习的反卷积模块;对于所有的上采样模块,把前一个空洞空间金字塔池化模块的输出通过反卷积使特征图的大小变为原来的两倍,然后级联多尺度特征融合模块输出的对应特征和上一个尺度粗估计的深度图;

[0035]

s43:对于所有的空洞空间金字塔池化模块,分别对输入特征执行包含不同空洞率的空洞卷积,输出为不同空洞卷积输出特征的级联。

[0036]

本发明的有益效果在于:1)本发明受空间注意力和通道注意力的启发,提出了一种基于注意力机制的多尺度特征融合模块,有效的实现了特征提取网络分层特征之间跨空间和跨尺度的特征融合;2)本发明在解码网络引入了语义分割领域的空洞空间金字塔池化模块,这不仅提高了网络学习局部细节的能力并使深度图在重建过程中完成了细粒度的预测,而且所引入的参数相对于整个网络来说也相对比较低。仿真结果表明,本发明与sarpn和acan算法相比具有更高的性能。

[0037]

本发明的其他优点、目标和特征在某种程度上将在随后的说明书中进行阐述,并且在某种程度上,基于对下文的考察研究对本领域技术人员而言将是显而易见的,或者可以从本发明的实践中得到教导。本发明的目标和其他优点可以通过下面的说明书来实现和获得。

附图说明

[0038]

为了使本发明的目的、技术方案和优点更加清楚,下面将结合附图对本发明作优选的详细描述,其中:

[0039]

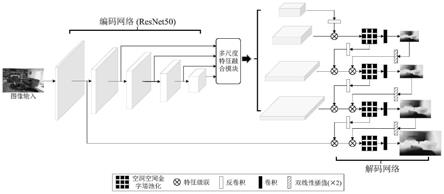

图1是本发明的基于多尺度特征融合的单目深度估计算法流程图;

[0040]

图2是本发明的注意力机制构建的流程图,(a)是基于自转换注意力模块,(b)是基于自上而下转换注意力模块,(c)是基于自下而上转换注意力模块;

[0041]

图3是本发明基于注意力机制构建的多尺度特征融合模块的流程图;

[0042]

图4是本发明提供的基于空洞空间金字塔池化模块构建的流程图;

[0043]

图5是本发明基于多尺度特征融合模块做的消融实验,图中的第3行是基础网络预测的深度图,第4行是基于多尺度特征融合模块改善编码网络特征提取能力后预测的深度

图;

[0044]

图6是本发明基于空洞空间金字塔池化模块做的消融实验,图中的第3列是基础网络预测的深度图,第4列是基于空洞空间金字塔池化模块改善解码网络的深度图重构能力后预测的深度图;

[0045]

图7是本发明采用改进的整个单目深度估计网络与acan网络预测深度图之间的对比示意图,图中的第2行是acan网络预测的深度图,第3行是本发明改进的网络预测的深度图。

具体实施方式

[0046]

以下通过特定的具体实例说明本发明的实施方式,本领域技术人员可由本说明书所揭露的内容轻易地了解本发明的其他优点与功效。本发明还可以通过另外不同的具体实施方式加以实施或应用,本说明书中的各项细节也可以基于不同观点与应用,在没有背离本发明的精神下进行各种修饰或改变。需要说明的是,以下实施例中所提供的图示仅以示意方式说明本发明的基本构想,在不冲突的情况下,以下实施例及实施例中的特征可以相互组合。

[0047]

其中,附图仅用于示例性说明,表示的仅是示意图,而非实物图,不能理解为对本发明的限制;为了更好地说明本发明的实施例,附图某些部件会有省略、放大或缩小,并不代表实际产品的尺寸;对本领域技术人员来说,附图中某些公知结构及其说明可能省略是可以理解的。

[0048]

本发明实施例的附图中相同或相似的标号对应相同或相似的部件;在本发明的描述中,需要理解的是,若有术语“上”、“下”、“左”、“右”、“前”、“后”等指示的方位或位置关系为基于附图所示的方位或位置关系,仅是为了便于描述本发明和简化描述,而不是指示或暗示所指的装置或元件必须具有特定的方位、以特定的方位构造和操作,因此附图中描述位置关系的用语仅用于示例性说明,不能理解为对本发明的限制,对于本领域的普通技术人员而言,可以根据具体情况理解上述术语的具体含义。

[0049]

请参阅图1~图6,为一种基于多尺度特征融合的单目深度估计方法。

[0050]

图1是本发明实施例提供的基于多尺度特征融合的单目深度估计网络结构图,如图所示,本发明实施例提供的基于多尺度特征融合的单目深度估计算法包括:

[0051]

在骨干网络的特征提取阶段,在不同层特征之间引入注意力机制,注意力机制的构造细节如图2所示。为了使标准的softmax层在图像上更加有效,构造了混合的softmax函数,归一化函数的计算公式如下:

[0052][0053][0054]

其中w

n

是一个网络训练中可学习的线性向量,是对应于特征图x上每个区域k

j

的算数均值,是第n个部分的相似度得分。

[0055]

然后是基于三种特征转换的构建,特征转换的实施细节如图3所示。首先通过自转

换,利用特征图上的其它特征点k

j

来对当前特征点q

i

进行关系建模,计算公式如下:

[0056][0057][0058]

其中,表示逐元素相乘。

[0059]

其次通过自上而下的特征转换,利用高维的语义信息对低维特征的上下文信息进行建模,计算公式如下:

[0060]

w

i,j

=f

mos

(f

eud

(q

i,n

,k

j,n

))

[0061][0062]

式中,f

eud

(

·

)表示特征图上两个像素点之间的欧式距离。

[0063]

最后通过自下而上的特征转换,在不同尺度的特征图通道之间进行相关信息建模,具体的计算公式如下:

[0064]

w=gap(k)

[0065]

q

att

=f

att

(q,w)

[0066]

v

dow

=f

sconv

(v)

[0067][0068]

其中,f

att

(

·

)代表外积函数,f

sconv

(

·

)是带步长的3

×

3卷积,f

conv

(

·

)是用来细化的3

×

3卷积,f

add

(

·

)表示两个特征图进行逐元素相加之后再次通过3

×

3卷积处理。

[0069]

基于注意力机制的多尺度特征融合模块的构建如图3所示,首先对编码网络的中间四层特征分别进行自转换、自上而下转换和自下而上转换,得到多个增强后的高级特征,然后对增强后的特征按尺度进行特征重排,将相同大小的特征与编码网络上的原特征进行级联,最后通过一个3

×

3卷积将增强后特征的通道维度恢复到输入时的相同维度,多尺度特征融合模块输出的特征相比输入的特征更加考虑了场景空间结构的上下文关系,极大的提高了特征提取网络的特征提取能力。

[0070]

最后针对编码网络在深度图重建过程中容易丢失图像特征,引入了空洞空间金字塔池化模块,该模块的构造如图4所示。具体的步骤为:

[0071]

1)通过在不同分辨率大小的特征图之间交叉嵌入多个空洞空间金字塔池化模块,从而捕获具有极大感受野的特征金字塔信息,以此来补偿上采样过程中丢失的特征信息;

[0072]

2)基于上采样的方法选择参数可学习的反卷积模块。对于所有的上采样模块,把前一个空洞空间金字塔池化模块的输出通过反卷积使特征图的大小变为原来的两倍,然后级联多尺度特征融合模块输出的对应特征和上一个尺度粗估计的深度图;

[0073]

3)对于所有的空洞空间金字塔池化模块,分别对输入特征执行包含不同空洞率的空洞卷积,该模块的输出为不同空洞卷积输出特征的级联。

[0074]

本发明使用nyu

‑

depth v2和kitti数据集中的数据对提出的基于多尺度特征融合的单目深度估计方法进行了实验,nyu

‑

depth v2数据集由microsoft kinect rgb

‑

d相机采集室内场景得到,由深度图和rgb图组成,而kitti数据集由雷达传感器和车载相机在各种道路环境下采集。这两个数据集是单目深度估计在室内外场景进行评测的常用数据集。

[0075]

图5表示的是本发明引入的多尺度特征融合模块前后结果对比图,图中的第1行是

输入的rgb图像,第2行是真实的深度图,第3行是本发明的基础网络预测的深度图,第4行是引入多尺度特征融合模块后预测的深度图。从图中可以看出基础网络预测的深度图尺度非常模糊,对物体边缘深度预测不清晰。经过多尺度特征融合模块提高编码网络的特征提取能力之后,深度图的预测变得更加准确,物体边缘轮廓也更为清晰。

[0076]

图6是本发明在解码网络引入的空洞空间金字塔池化模块前后结果对比图,图中的第1列是输入的rgb图像,第2列是真实的深度图,第3列是本发明的基础网络预测的深度图,第4列是引入空洞空间金字塔池化模块后预测的深度图。从图中可以看出针对解码网络做出改进之后,使网络对一些物体的局部细节恢复的更加准确。观察第2排白色框内的书架,书架的真实深度图是缺失的,改进后的网络对缺失的深度图进行补全。因此,空洞空间金字塔池化模块的引入能够有效的解决图像细节信息的丢失,并且完成了细粒度的预测。

[0077]

图7是本发明改进的整个单目深度估计网络与acan单目深度估计网络之间预测的深度图对比示意图。采用kitti数据集,图中的第1行是输入的rgb图像,第2行acan网络估计的深度图,第3行是本发明改进的网络估计的深度图。从图中可以看出,acan网络对对近点的目标预测不清晰,对远处的目标深度往往预测失败,而本发明改进的网络预测的深度图能够对各种目标保留清晰的轮廓以及细节信息,极大的提高了单目深度估计的精度。

[0078]

表1统计了本发明的方法与其它不同算法在nyu

‑

depth v2数据集下的平均相对误差、均方根误差、对数平均误差和阈值下的准确率。从表1中的数据可以看出,本发明的方法在绝大多数指标上都取得了较好的结果,对深度图估计的精度有一定的提升。本发明的方法与sarpn相比,阈值准确率提高了1.2%,并且其它几个指标的误差都有不同程度的降低。本发明的方法与acan相比,平均相对误差降低了16%,阈值准确率提高了5.3%。可以明显的看出,使用基于注意力机制的多尺度特征融合模块的优势体现了出来。

[0079]

表1

[0080][0081]

本发明提出的一种基于多尺度特征融合的单目深度估计算法有效解决了特征提取网络特征提取不充分和丢失空间信息等问题,提高了网络预测深度图的精度。首次将注意力机制应用到骨干网络的分层特征之间,着重考虑了特征之间的空间结构关系。并且在解码网络引入空洞空间金字塔池化模块,弥补了深度图重建过程中图像特征丢失问题,扩大了局部卷积的感受野。仿真结果表明,本发明提出的多尺度特征融合的单目深度估计算法在精度、物体边缘轮廓重建等方面都取得了不错的效果,具有良好的性能。

[0082]

最后说明的是,以上实施例仅用以说明本发明的技术方案而非限制,尽管参照较佳实施例对本发明进行了详细说明,本领域的普通技术人员应当理解,可以对本发明的技术方案进行修改或者等同替换,而不脱离本技术方案的宗旨和范围,其均应涵盖在本发明的权利要求范围当中。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1