一种客服人员声音感染力的评测方法及系统与流程

[0001]

本发明涉及声音识别评测领域,尤其涉及一种客服人员声音感染力的评测方法及系统。

背景技术:

[0002]

传统行业或现在主流的借助互联网平台经营的各种行业,都离不开客服人员。尤其是新兴行业与高科技行业,大家的技术实力与产品质量往往不相上下,而这个时候比拼的就是服务质量。所以,大部分公司有配有客服部门及相应的客服人员,且都比较重视这个部门与相应的人员。相应的这些人的服务能力对企业的声誉或销售有着较大的影响力,客服人员的服务能力包括了话术和感染力两个主要方面。其中话术包括了业务知识、沟通技巧、心理学、情商等方面,主要是通过后期培养。而感染力则是一个人的天生能力,很难通过后天的努力学习及训练做出较大的改变。所以,如何在早期就准确识别出一个人是否适合客服这个岗位,对企业在招聘客服人员时将是一个很大的帮助。现有技术中,有通过声音识别并进行情绪实现对客服人员声音情绪识别的目的,也有通过客户情绪识别判断客服服务质量的,但是这些方法都无法从根本上实现对客服人员本身声音感染的评测,现有技术中能够实现感染力评测的唯一方式是通过人工评价,现有技术中缺少具有权威性的机器评价声音感染力的方式。

技术实现要素:

[0003]

本发明要解决的技术问题是如何实现对客服声音的感染力进行机器评价,针对上述要解决的技术问题,现提出一种客服人员声音感染力的评测方法及系统。

[0004]

为实现上述目的,本发明提供如下技术方案:一种客服人员声音感染力的评测方法,其通过如下步骤实现对客服人员声音感染力的评测:

[0005]

样本选择,抽取客服声音样本,按照预定的评价方式对样本进行感染力评分并分级,并按照分级标准将等级作为标签标记到客服声音样本中;

[0006]

样本识别,通过对声音样本进行频谱化处理得到声音样本的频谱数据,并将声音样本标记的等级与频谱数据进行对应,对应后的数据分成训练样本和评价样本;

[0007]

特征提取,对样本识别步骤中得到的频谱数据进行特征值提取,所述特征值包括频率、音量和音高;

[0008]

模型训练,将提取的训练样本的特征值和对应的分级标签代入到深度学习网络中进行模型训练;

[0009]

训练结果评估,将评价样本的特征值代入到模型训练步骤生成的训练模型中进行识别得到声音感染力分级,将识别结果与评价样本自身对应标签的分级进行比较,若识别的准确率达到预设的准确率则保存当前步骤的训练模型并进行下一步,若识别的准确率未达到预设的准确率则返回模型训练步骤继续进行训练;

[0010]

目标声音识别,对目标声音进行频谱化处理得到目标声音的频谱数据,并对目标

声音的频谱数据进行特征值提取,将提取的特征值输入到训练模型中进行识别得到目标声音的感染力分级。

[0011]

优选的,感染力分级分为五级,分别为一级、二级、三级、四级和五级,一级为感染力最差,五级为感染力最强。

[0012]

进一步的,所述目标声音识别步骤中还包括情绪识别过程,所述情绪识别过程为基于声音情绪识别算法的情绪识别过程,所述情绪识别过程输出目标声音的情绪情况。

[0013]

进一步的,所述深度学习网络为基于卷积神经网络的深度学习网路。

[0014]

进一步的,所述深度学习网络为基于循环神经网络的深度学习网路。

[0015]

进一步的,所述深度学习网络为基于深度信念网络的深度学习网路。

[0016]

进一步的,所述深度学习网络对特征值进行识别之前还包括预处理步骤,所述预处理步骤包括对特征值的加权处理。

[0017]

本发明的另一个目的是提供一种客服人员声音感染力的评测系统,其包括声音录入模块、评级模块、声音识别模块、特征提取模块、深度学习模块和输出模块,所述声音录入模块用于录入样本声音和目标声音,所述评级模块用于录入对样本声音的评级标签,所述声音识别模块用于对样本声音和目标声音进行频谱化处理,所述特征提取模块用于对样本声音和目标声音的频谱数据进行特征值提取,所述深度学习模块用于对样本声音特征值与标签数据进行深度学习和识别并根据目标声音的特征值对目标声音的感染力等级进行识别,所述输出模块用于输出目标声音的感染力识别结果。

[0018]

与现有技术相比,本发明的有益效果是:

[0019]

本发明通过采用深度学习的模型,通过对人工评价过的样本声音进行深度自学习,最终实现机器识别目标声音的感染力等级,实现了对客服声音感染力的机器评价,是的评价结果更加权威和标准,并且能够在前期就对声音感染力进行评估,从而大大降低客服培训和培养的成本。

附图说明

[0020]

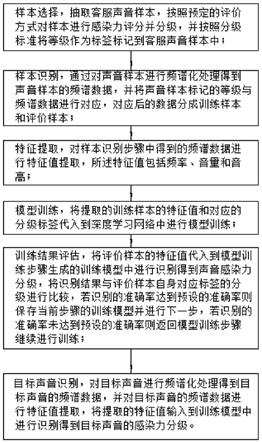

图1为本发明的方法流程示意图。

具体实施方式

[0021]

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0022]

如图1所示,本具体实施方式披露了一种客服人员声音感染力的评测方法,其通过如下步骤实现对客服人员声音感染力的评测:

[0023]

样本选择,抽取客服声音样本,按照预定的评价方式对样本进行感染力评分并分级,并按照分级标准将等级作为标签标记到客服声音样本中。可行的,样本声音的采集及评级过程可以通过多维度评价的方式进行,例如可以从客户满意度、公司绩效完成度、同事好感、领导评价等多个维度进行评价,评价过程中可以采用随机遮盖评价的方式避免人员代入主观的偏见。具体的,评级方式可以根据每个公司的不同要求进行设置,各个维度的评价

完成后进行加权算总分,根据总分分值的不同划分等级。例如在本具体实施方式中可以将感染力等级划分为五个等级,分别为一级、二级、三级、四级和五级,一级为感染力最差,五级为感染力最强。样本的分级将作为标签与样本的音频数据共同存储,可以通过设置映射表的方式进行存储,方便后续步骤读取各个音频数据的标签信息。为了使后续机器学习更加准确,样本的选取需要尽可能具有多样性、广范围和丰富度。例如在本具体实施例中,男女声样本将等比例设置,样本声音的年龄段按照实际的客服人员年龄占比进行选取,且样本采集的数量在可接受范围内保证尽可能大,此外,在其他要素上同样也采用尽可能分布广的方式采集。作为优选的,在样本声音评价完成后,对所有样本的得分进行统计,尽可能做到样本采集概括到所有分值区间,为了更好的反应真实情况,可以将部分非客服人员的声音样本混入到采集样本中。

[0024]

样本识别,通过对声音样本进行频谱化处理得到声音样本的频谱数据,并将声音样本标记的等级与频谱数据进行对应,对应后的数据分成训练样本和评价样本。作为优选的,各个等级内的样本均平分到训练样本和评价样本中,从而使得后续的评价过程更加准确。数据的频谱化过程可以通过如下方式实现,先采用频谱转化系统将音频数据转化为频谱图,再通过读取频谱图的信息获取,例如可以通过梅尔谱系数法获取频谱图。在获取特征值之前需要将目标声音的音频信息数据转化为音频图谱信息。可行的,在本发明的其他具体实施方式中也可以采用其他频谱化方式获取频谱信息进行识别数据。

[0025]

特征提取,对样本识别步骤中得到的频谱数据进行特征值提取,所述特征值包括频率、音量和音高,在本发明的其他具体实施方式中也可以根据用户需求增加其他特征参数。其中,音量可以通过音频信息的振幅获取,而频率可以通过音频识别软件对音频图谱扫描识别得到。而音高则通过扫描音频图谱的峰值得到。特征提取的过程可以通过机器自动实现,例如通过机器自动在频谱图上读出数据,采用现有技术中的机器读取方式即可。在本发明的其他具体实施方式中也可以采用基于深度学习识别进行读取的方式读取。

[0026]

模型训练,将提取的训练样本的特征值和对应的分级标签代入到深度学习网络中进行模型训练。具体的,机器深度学习的过程还可以包括多次卷积处理,其可以采用基于卷积神经网络的深度学习网路。通过卷积和池化实现识别,与标签之间建立对应的关系,采用网络可以采用例如lenet-5、vgg、alexnet等。深度学习网络也可以采用基于循环神经网络的深度学习网路,采用循环网络可以在识别过程中增加情绪识别的步骤。此外,作为优选的,所述深度学习网络为基于深度信念网络的深度学习网路。当采用基于深度信念网络的深度学习网络时,所述深度学习网络对特征值进行识别之前还包括预处理步骤,所述预处理步骤包括对特征值的加权处理。可以根据具体的需求给各个特征值增加预加权系数,从而可以根据需求对各个特征值给予权重。例如,在用户增加除本具体实施例中的其他特征参数后,例如音色,可以对其进行加权处理,例如音频、音高和音量各加权重0.2,音色加权0.4,虽然目前现有技术中尚未有相关针对音色特征提取的方法,但是若存在相关方法则可以加入音色。这样加权是因为音色是先天的,无法通过后期训练改变的,若音色不符合作为客服人员的要求则不应作为客服人员,因此将音色的比重加大。可行的,预处理的过程可以通过机器语言进行实现。

[0027]

训练结果评估,将评价样本的特征值代入到模型训练步骤生成的训练模型中进行识别得到声音感染力分级,将识别结果与评价样本自身对应标签的分级进行比较,若识别

的准确率达到预设的准确率则保存当前步骤的训练模型并进行下一步,若识别的准确率未达到预设的准确率则返回模型训练步骤继续进行训练。例如在本具体实施例中可以设定识别准确率大于90%即达到要求。在输入评价样本后,评价样本通过上一步骤得到训练模型进行识别,识别结果与自身所带的标签进行比较,得到的等级与标签的等级一致则记作识别准确,否则记作识别不准。可行的,比对的过程可以通过机器语言实现。此外,为了提高模型的准确率,可以在训练较多样本后再进行训练结果评估,例如每50组结果后进行50次训练结果评估。

[0028]

目标声音识别,对目标声音进行频谱化处理得到目标声音的频谱数据,并对目标声音的频谱数据进行特征值提取,将提取的特征值输入到训练模型中进行识别得到目标声音的感染力分级。可行的,在本发明的另一个具体实施方式中,所述目标声音识别步骤中还包括情绪识别过程,所述情绪识别过程为基于声音情绪识别算法的情绪识别过程,所述情绪识别过程输出目标声音的情绪情况。因为情绪容易带来主观偏见,因而可以将情绪识别的结果输出供参考。

[0029]

此外,上述方法可以通过一系统进行实现,其包括声音录入模块、评级模块、声音识别模块、特征提取模块、深度学习模块和输出模块,所述声音录入模块用于录入样本声音和目标声音,该设备可以是一数字录音器,其也可以接收来自数据传输或存储设备读取的声音数据。所述评级模块用于录入对样本声音的评级标签,可行的,评级标签是人工打分的,可以在录入前建立评级表,通过导入到数据库中形成映射关系,在后续的特征值提取完成后调取映射的表单数据进行组成数据组。可行的,录入也可以通过键盘等数据录入硬件录入到计算机中。所述声音识别模块用于对样本声音和目标声音进行频谱化处理,该模块可以是设置在计算机内的频谱处理软件。所述特征提取模块用于对样本声音和目标声音的频谱数据进行特征值提取,该模块可以是基于频谱图进行机器语言识别的软件程序,其可以自动运行并输出结果到深度学习模块。所述深度学习模块用于对样本声音特征值与标签数据进行深度学习和识别并根据目标声音的特征值对目标声音的感染力等级进行识别,深度学习模块将深度学习网络搭载在计算机上通过自动运行输出结果,训练和识别过程也可以通过手动开启。所述输出模块用于输出目标声音的感染力识别结果,该模块可以内置在装载深度学习网络的软件内的,识别结果通过其内部界面输出器输出到计算机的显示器上。

[0030]

本发明通过采用深度学习的模型,通过对人工评价过的样本声音进行深度自学习,最终实现机器识别目标声音的感染力等级,实现了对客服声音感染力的机器评价,是的评价结果更加权威和标准,并且能够在前期就对声音感染力进行评估,从而大大降低客服培训和培养的成本。

[0031]

以上结合附图对本发明的实施方式作了详细说明,但本发明不限于所描述的实施方式。对于本领域的技术人员而言,在不脱离本发明原理和精神的情况下,对这些实施方式进行多种变化、修改、替换和变型,仍落入本发明的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1