人脸活体检测方法、装置、电子设备及存储介质与流程

1.本公开涉及人工智能技术领域,尤其涉及计算机视觉和深度学习技术领域,可应用于人脸识别等场景。

背景技术:

2.随着电子商务等技术的发展,基于人脸的身份验证已经得到广泛的应用,基于人脸的身份验证主要是通过人脸识别技术来实现,在人脸识别技术极大提高了人们生活便利性的同时,其安全性问题也逐渐暴露,例如通过打印照片、屏幕照片等伪装为实体人脸通过验证。

3.可见,人脸识别技术中,需要人脸活体检测技术来判断人脸图像是否是通过拍摄活体人脸得到的。

技术实现要素:

4.本公开提供了一种人脸活体检测方法、装置、设备以及存储介质。

5.根据本公开的一方面,提供了一种人脸活体检测方法,所述方法包括:

6.获取待检测的人脸彩色图像;

7.将所述人脸彩色图像分别输入预先训练的第一编解码重建模型和第二编解码重建模型,分别得到人脸重建红外图像和人脸重建深度图像;

8.将所述人脸彩色图像、所述人脸重建红外图像和所述人脸重建深度图像输入预先训练的多模态检测网络模型,得到活体检测结果。

9.根据本公开的另一方面,提供了一种人脸活体检测装置,包括:

10.获取模块,用于获取待检测的人脸彩色图像;

11.重建模块,用于将所述人脸彩色图像分别输入预先训练的第一编解码重建模型和第二编解码重建模型,分别得到人脸重建红外图像和人脸重建深度图像;

12.检测模块,用于将所述人脸彩色图像、所述人脸重建红外图像和所述人脸重建深度图像输入预先训练的多模态检测网络模型,得到活体检测结果。

13.根据本公开的又一方面,提供了一种电子设备,包括:

14.至少一个处理器;以及

15.与所述至少一个处理器通信连接的存储器;其中,

16.所述存储器存储有可被所述至少一个处理器执行的指令,所述指令被所述至少一个处理器执行,以使所述至少一个处理器能够执行人脸活体检测方法。

17.根据本公开的又一方面,提供了一种存储有计算机指令的非瞬时计算机可读存储介质,其中,所述计算机指令用于使所述计算机执行人脸活体检测方法。

18.根据本公开的又一方面,提供了一种计算机程序产品,包括计算机程序,所述计算机程序在被处理器执行时实现人脸活体检测方法。

19.应当理解,本部分所描述的内容并非旨在标识本公开的实施例的关键或重要特

征,也不用于限制本公开的范围。本公开的其它特征将通过以下的说明书而变得容易理解。

附图说明

20.附图用于更好地理解本方案,不构成对本公开的限定。其中:

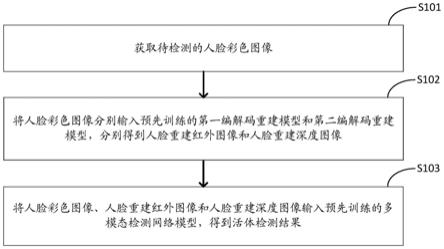

21.图1为本公开实施例提供的人脸活体检测方法的一种流程示意图;

22.图2为本公开实施例提供的获取人脸样本图像的一种流程示意图;

23.图3为本公开实施例提供的人脸活体检测方法的一种示意图;

24.图4是用来实现本公开实施例的人脸活体检测方法的装置的框图;

25.图5是用来实现本公开实施例的人脸活体检测方法的电子设备的框图。

具体实施方式

26.以下结合附图对本公开的示范性实施例做出说明,其中包括本公开实施例的各种细节以助于理解,应当将它们认为仅仅是示范性的。因此,本领域普通技术人员应当认识到,可以对这里描述的实施例做出各种改变和修改,而不会背离本公开的范围和精神。同样,为了清楚和简明,以下的描述中省略了对公知功能和结构的描述。

27.人脸活体检测是人脸相关领域的基础技术之一,可以应用于考勤、门禁通行等诸多场景。在当前的很多业务上都有广泛的应用。

28.目前,通常采用卷积神经网络进行人脸活体检测,卷积神经网络的输入为人脸彩色图像。然而,仅基于彩色图像的人脸活体检测存在对光线较敏感导致检测准确率不高、且对照片、视频等平面攻击的防御效果较差的技术问题。

29.为了解决上述技术问题,本公开提供了一种人脸活体检测方法、装置、电子设备及存储介质。

30.本公开的一个实施例中,提供了一种人脸活体检测方法,方法包括:

31.获取待检测的人脸彩色图像;

32.将人脸彩色图像分别输入预先训练的第一编解码重建模型和第二编解码重建模型,分别得到人脸重建红外图像和人脸重建深度图像;

33.将人脸彩色图像、人脸重建红外图像和人脸重建深度图像输入预先训练的多模态检测网络模型,得到活体检测结果。

34.可见,通过样本图像集训练两个编解码重建模型,使得第一编解码重建模型学习到人脸彩色图像的图像特征所对应的人脸红外图像的图像特征,使得第二编解码重建模型学习到人脸彩色图像的图像特征所对应的人脸深度图像的图像特征,从而根据待检测的人脸彩色图像重建出人脸红外图像和人脸深度图像,然后将人脸彩色图像和重建的人脸红外图像、人脸深度图像输入多模态的网络模型,多模态的网络模型对人脸的彩色图像特征、红外图像特征和深度图像特征进行融合,相比于仅基于彩色图像的人脸活体检测,能够降低对光线的敏感度,大大提高检测准确率,且提高网络的泛化能力,从而提高对照片、视频等平面攻击的防御效果,同样提高了对于未知攻击样本的防御效果。

35.并且,在检测过程中,仅利用人脸彩色图像即可进行人脸活体的多模态融合检测,也就是说,根据一张人脸彩色图像即可进行多模态的人脸活体检测,不需要再采集人脸红外图像和人脸深度图像。

36.下面对本公开实施例提供的人脸活体检测方法、装置、电子设备及存储介质分别进行详细介绍。

37.参见图1,图1为本公开实施例提供的人脸活体检测方法的一种流程示意图,如图1所示,方法可以包括以下步骤:

38.s101:获取待检测的人脸彩色图像。

39.本公开实施例中,当需要进行人脸活体检测时,获取待检测的人脸彩色图像。其中,人脸活体检测可以理解为:检测人脸图像是否是通过拍摄活体人脸得到的。其中,彩色图像可以是rgb(red

‑

green

‑

bule,红绿蓝三原色)图像。

40.本公开实施例对获取人脸彩色图像的途径不做限定。

41.s102:将人脸彩色图像分别输入预先训练的第一编解码重建模型和第二编解码重建模型,分别得到人脸重建红外图像和人脸重建深度图像。

42.本公开的一个实施例中,第一编解码重建模型是根据多个第一样本图像集训练的,每个第一样本图像集包括:相互配准的人脸彩色样本图像和人脸红外样本图像;第二编解码重建模型是根据多个第二样本图像集训练的,每个第二样本图像集包括:相互配准的人脸彩色样本图像和人脸深度样本图像。

43.本公开实施例中,第一编解码重建模型和第二编解码重建模型均为encoder

‑

decoder(编码

‑

解码)框架的模型。

44.本公开实施例中,可以预先根据多个第一样本图像集训练第一编码重建模型,每个第一样本图像集包括:相互配准的人脸彩色样本图像和人脸红外样本图像。

45.其中,所谓人脸彩色样本图像和人脸红外样本图像相互配准是指:人脸彩色样本图像和人脸红外样本图像的图像尺寸、像素数目、针对同一人脸所拍摄的实际区域及拍摄角度均相同,且像素点一一对应。

46.相应的,所谓人脸彩色样本图像和人脸深度样本图像相互配准是指:人脸彩色样本图像和人脸深度样本图像的图像尺寸、像素数目、针对同一人脸所拍摄的实际区域及拍摄角度均相同,且像素点一一对应。

47.例如,利用包含rgb摄像头、nir(near infrared,近红外)摄像头和深度摄像头的多目相机,同时拍摄活体人脸,分别得到人脸彩色样本图像、人脸红外样本图像和人脸深度样本图像。

48.在获取大量的样本图像集之后,分别对第一编解码重建模型和第二编解码重建模型进行训练。以第一编解码重建模型为例,在训练过程中,输入人脸彩色样本图像,输出是与人脸彩色样本图像的尺寸相同的特征图,结合已存的人脸红外样本图像,对重建模型进行l1监督训练。例如,设置损失函数,基于输出的特征图和人脸红外样本图像计算损失值,根据损失值调整第一编解码重建模型中的模型参数。经过迭代训练后,第一编解码重建模型能够学习到人脸红外图像的特征。从而,在训练完成后,向训练完成的第一编解码重建模型输入人脸彩色图像,第一编解码重建模型能够输出重建的人脸彩色图像对应的人脸红外图像。

49.相应的,基于同样的原理训练第二编解码重建模型,训练完成后,能够根据输入的人脸彩色图像重建出对应的人脸深度图像。

50.本公开实施例中,将人脸彩色图像分别输入训练完成的第一编解码重建模型和第

二编解码重建模型,可以分别得到人脸重建红外图像和人脸重建深度图像。

51.s103:将人脸彩色图像、人脸重建红外图像和人脸重建深度图像输入预先训练的多模态检测网络模型,得到活体检测结果。

52.本公开的一个实施例中,多模态检测网络模型是根据多个活体样本图像集和/或多个非活体样本图像集训练的,每个活体样本图像集包括:相互配准的活体人脸彩色图像、活体人脸红外图像、活体人脸深度图像;每个非活体样本图像集包括:相互配准的非活体人脸彩色图像、非活体人脸红外图像、非活体人脸深度图像。

53.本公开实施例中,可以预先训练多模态检测网络模型,其中,多模态检测也就是基于多模态特征进行检测。

54.活体检测结果为二分类结果,因此可以采集大量的正样本和负样本用于网络模型训练。正样本即活体样本图像集,具体包括:相互配准的活体人脸彩色图像、活体人脸红外图像、活体人脸深度图像。也就是说,活体样本图像集中的图像都是通过拍摄活体人脸得到的。其中,相互配准所表示的含义可以参见上文。

55.负样本即非活体样本图像集,具体包括:相互配准的非活体人脸彩色图像、非活体人脸红外图像和非活体人脸深度图像。也就是说,非活体样本图像集中的图像都不是通过拍摄活体人脸得到的,例如,通过拍摄照片、电子设备屏幕等方式得到的。

56.作为一个示例,利用包含rgb摄像头、nir摄像头和深度摄像头的多目相机,同时拍摄照片中的人脸区域,分别得到非活体人脸彩色图像、非活体人脸红外图像和非活体人脸深度图像。

57.正样本的标签为活体,负样本的标签为非活体,根据上述正样本、负样本以及对应的标签即可训练多模态检测网络模型。具体的,将正样本或负样本输入深度学习神经网络模型,得到输出结果,根据输出结果和真实标签计算损失值,基于损失值调整深度学习神经网络模型中的模型参数,当损失值达到预设阈值或迭代次数达到预设次数,训练完成。训练完成的深度学习神经网络即为多模态检测网络模型。

58.本公开的一个实施例中,多模态检测网络模型可以包括:卷积层、注意力机制模块、全局平均池化层和全连接层。其中,卷积层包括并行的第一子卷积层、第二子卷积层和第三子卷积层。相应的,将人脸彩色图像、人脸重建红外图像和人脸重建深度图像输入预先训练的多模态检测网络模型,具体为:分别将人脸彩色图像、人脸重建红外图像和人脸重建深度图像输入多模态检测网络模型的第一子卷积层、第二子卷积层和第三子卷积层。

59.针对每个子卷积层,可以选取适当的神经网络结构、子卷积层的层数和输出的特征图数目。

60.作为一个示例,采用mobilenet作为子卷积层的神经网络结构,用于提取彩色图像特征的第一子卷积层最后一层的特征图数量为256,用于提取红外图像特征的第二子卷积层最后一层的特征图数量为128,用于提取深度图像特征的第三子卷积层最后一层的特征图数量为128。随后三个子卷积层的特征图进行合并得到数量为512的特征图,再依次连接se(squeeze

‑

and

‑

excitation)注意力模块、全局平均池化层和全连接层。

61.本公开实施例中,上述人脸彩色图像、人脸红外图像和人脸深度图像可以理解为三路输入数据流,可见,拥有三路输入数据流的多模态检测网络模型能够提取多模态特征并通过注意力模块进行融合,得到最终的人脸活体检测结果。

62.可见,本公开实施例中,通过样本图像集训练两个编解码重建模型,使得第一编解码重建模型学习到人脸彩色图像的图像特征所对应的人脸红外图像的图像特征,使得第二编解码重建模型学习到人脸彩色图像的图像特征所对应的人脸深度图像的图像特征,从而根据待检测的人脸彩色图像重建出人脸红外图像和人脸深度图像,然后将人脸彩色图像和重建的人脸红外图像、人脸深度图像输入多模态的网络模型,多模态的网络模型对人脸的彩色图像特征、红外图像特征和深度图像特征进行融合,相比于仅基于彩色图像的人脸活体检测,能够降低对光线的敏感度,大大提高检测准确率,且提高网络的泛化能力,从而提高对照片、视频等平面攻击的防御效果,同样提高了对于未知攻击样本的防御效果。

63.并且,在检测过程中,仅利用人脸彩色图像即可进行人脸活体的多模态融合检测,也就是说,根据一张人脸彩色图像即可进行多模态的人脸活体检测,不需要再采集人脸红外图像和人脸深度图像。

64.此外,多模态的特征信息有利于模型学习,明显加快了模型收敛速度。

65.本公开的一个实施例中,在步骤s101之后,步骤s102之前,还可以包括:对人脸彩色图像进行人脸关键点检测,并基于人脸关键点检测结果进行人脸图像矫正,对矫正后的图像进行归一化处理。

66.具体的,在获取人脸彩色图像之后,可以先进行人脸区域检测,得到人脸的大致位置区域。例如,将人脸彩色图像输入人脸区域检测模型,得到人脸所在位置区域。

67.然后通过人脸关键点检测模型,对人脸所在位置区域进行检测,得到人脸的关键点坐标值。其中人脸的关键点是预先定义的,例如比如鼻子左侧,鼻孔下侧,瞳孔位置,嘴唇下侧等位置。

68.作为一个示例,定义72个人脸关键点,则人脸关键点检测模型能够输出72个坐标,即(x1,y1)

…

(x

72

,y

72

)。

69.在得到人脸关键点之后,可以基于人脸关键点坐标进行人脸图像矫正,人脸图像矫正也叫人脸对齐,可以通过仿射变换实现。具体的,根据检测到的人脸关键点和预先设置的虚拟正面人脸关键点,计算仿射变换的仿射矩阵r、t,然后利用仿射矩阵将人脸图像映射到正面,截取仿射变换后的人脸区域。也就是说,通过人脸图像矫正能够将角度不正的人脸图像映射为角度较正的人脸图像。

70.本公开实施例中,为了提高人脸活体检测的鲁棒性,可以对矫正后的图像进行归一化处理。针对矫正后的人脸图像中每个像素点进行归一化处理,具体为:每个像素点的像素值减128再除以256,使得每个像素点的像素值都在[

‑

0.5,0.5]之间。

[0071]

可见,本公开实施例中,对人脸彩色图像进行人脸区域检测、人脸关键点检测、人脸图像矫正和归一化处理,再作为第一编解码重建模型、第二编解码重建模型和多模态检测网络模型的输入,能够进一步提高人脸活体检测的准确度。

[0072]

本公开的一个实施例中,样本图像集中的人脸彩色样本图像、人脸红外样本图像和人脸深度样本图像也可以是经过人脸区域检测、人脸图像矫正和归一化处理得到的。

[0073]

具体的,参见图2,图2为本公开实施例提供的获取人脸样本图像的一种流程示意图,如图2所示,可以采用如下方式获取人脸彩色样本图像、人脸红外样本图像和人脸深度样本图像:

[0074]

s201:获取相互配准的初始人脸彩色图像、初始人脸红外图像和初始人脸深度图

像。

[0075]

其中,相互配准所表示的含义可以参见上文。

[0076]

作为一个示例,利用包含rgb摄像头、nir摄像头和深度摄像头的多目相机,同时拍摄活体人脸,分别得到初始人脸彩色图像、初始人脸红外图像和初始人脸深度图像。

[0077]

s202:对初始人脸彩色图像进行人脸关键点检测,并基于人脸关键点检测结果进行人脸图像矫正,对矫正后的图像进行归一化处理,得到人脸彩色样本图像。

[0078]

人脸关键点检测、人脸图像矫正和归一化处理过程可以参见上文,不再赘述。

[0079]

s203:基于初始人脸彩色图像的人脸关键点检测结果,分别对初始人脸红外图像和初始人脸深度图像进行人脸图像矫正,并分别对矫正后的图像进行归一化处理,得到人脸红外样本图像和人脸深度样本图像。

[0080]

本公开实施例中,对于相互配准的初始人脸彩色图像、初始人脸红外图像和初始人脸深度图像,图像尺度相同、像素数目相同、且像素点一一对应,因此可以直接根据初始人脸彩色图像的人脸关键点检测结果,对初始人脸红外图像和初始人脸深度图像进行人脸图像矫正。也就是说,初始人脸彩色图像的人脸关键点检测结果,也可以作为初始人脸红外图像和初始人脸深度图像的人脸关键点检测结果,因此针对相互配准的上述三张图像,可以采用相同的仿射矩阵进行仿射变换,实现人脸图像矫正。

[0081]

在得到人脸彩色样本图像、人脸红外样本图像和人脸深度样本图像后,可以对图像进行随机数据增强处理,例如,随机进行裁剪、翻转、对比度设置和亮度设置,以得到更多的样本图像,更好的训练模型,且提高模型的泛化能力。

[0082]

可见,本公开实施例中,在初始人脸图像的基础上,依次进行人脸区域检测、人脸关键点检测、人脸图像矫正和归一化处理,再作为模型的训练样本,便于模型提取有效的图像特征,进一步提高了人脸活体检测的检测准确性。

[0083]

为了便于理解,下面结合附图图3对本公开实施例提供的人脸活体检测方法进行进一步说明。图3为本公开实施例提供的人脸活体检测方法的一种示意图。

[0084]

如图3所示,将待检测的人脸彩色图像依次进行人脸区域检测、人脸图像矫正和图像预处理。其中图像预处理可以是归一化处理。将图像预处理后的人脸彩色图像分别输入第一编解码重建模型和第二编解码重建模型,分别得到人脸重建红外图像和人脸重建深度图像。再将图像预处理后的人脸彩色图像、人脸重建红外图像和人脸重建深度图像分别输入多模态检测网络模型中的各个mobilenet卷积层,再依次经过se注意力机制模块、全局平均池化层和全连接层,得到人脸活体检测结果。

[0085]

可见,本公开实施例中,通过样本图像集训练两个编解码重建模型,使得第一编解码重建模型学习到人脸彩色图像的图像特征所对应的人脸红外图像的图像特征,使得第二编解码重建模型学习到人脸彩色图像的图像特征所对应的人脸深度图像的图像特征,从而根据待检测的人脸彩色图像重建出人脸红外图像和人脸深度图像,然后将人脸彩色图像和重建的人脸红外图像、人脸深度图像输入多模态的网络模型,多模态的网络模型对人脸的彩色图像特征、红外图像特征和深度图像特征进行融合,相比于仅基于彩色图像的人脸活体检测,能够降低对光线的敏感度,大大提高检测准确率,且提高网络的泛化能力,从而提高对照片、视频等平面攻击的防御效果,同样提高了对于未知攻击样本的防御效果。

[0086]

并且,在检测过程中,仅利用人脸彩色图像即可进行人脸活体的多模态融合检测,

也就是说,根据一张人脸彩色图像即可进行多模态的人脸活体检测,不需要再采集人脸红外图像和人脸深度图像。

[0087]

此外,能够加快网络训练收敛速度、提高现实场景使用人脸活体检测算法的泛化性和精度,能够提升人脸活体检测技术性能,帮助以人脸活体检测技术为基础的诸多应用提升效果和用户体验,有利于业务项目的进一步推广。

[0088]

参见图4,图4是用来实现本公开实施例的人脸活体检测方法的装置的框图,如图4所示,装置可以包括:

[0089]

获取模块401,用于获取待检测的人脸彩色图像;

[0090]

重建模块402,用于将所述人脸彩色图像分别输入预先训练的第一编解码重建模型和第二编解码重建模型,分别得到人脸重建红外图像和人脸重建深度图像;

[0091]

检测模块403,用于将所述人脸彩色图像、所述人脸重建红外图像和所述人脸重建深度图像输入预先训练的多模态检测网络模型,得到活体检测结果。

[0092]

本公开的一个实施例中,所述第一编解码重建模型是根据多个第一样本图像集训练的,每个第一样本图像集包括:相互配准的人脸彩色样本图像和人脸红外样本图像;所述第二编解码重建模型是根据多个第二样本图像集训练的,每个第二样本图像集包括:相互配准的人脸彩色样本图像和人脸深度样本图像;所述多模态检测网络模型是根据多个活体样本图像集和/或多个非活体样本图像集训练的,每个活体样本图像集包括:相互配准的活体人脸彩色图像、活体人脸红外图像、活体人脸深度图像;每个非活体样本图像集包括:相互配准的非活体人脸彩色图像、非活体人脸红外图像、非活体人脸深度图像。

[0093]

本公开的一个实施例中,在图4所示装置基础上,还可以包括:

[0094]

预处理模块,用于在将所述人脸彩色图像分别输入预先训练的第一编解码重建模型和第二编解码重建模型之前,对所述人脸彩色图像进行人脸关键点检测,并基于人脸关键点检测结果进行人脸图像矫正,对矫正后的图像进行归一化处理。

[0095]

本公开的一个实施例中,在图4所示装置基础上,还可以包括:

[0096]

样本图像获取模块,用于采用如下方式获取人脸彩色样本图像、人脸红外样本图像和人脸深度样本图像:

[0097]

获取相互配准的初始人脸彩色图像、初始人脸红外图像和初始人脸深度图像;

[0098]

对所述初始人脸彩色图像进行人脸关键点检测,并基于人脸关键点检测结果进行人脸图像矫正,对矫正后的图像进行归一化处理,得到所述人脸彩色样本图像;

[0099]

基于所述初始人脸彩色图像的人脸关键点检测结果,分别对所述初始人脸红外图像和所述初始人脸深度图像进行人脸图像矫正,并分别对矫正后的图像进行归一化处理,得到所述人脸红外样本图像和所述人脸深度样本图像。

[0100]

本公开的一个实施例中,多模态检测网络模型包括:

[0101]

卷积层、注意力机制模块、全局平均池化层和全连接层,其中卷积层包括并行的第一子卷积层、第二子卷积层和第三子卷积层;

[0102]

所述检测模块,具体可以用于:分别将所述人脸彩色图像、所述人脸重建红外图像和所述人脸重建深度图像输入所述多模态检测网络模型的第一子卷积层、第二子卷积层和第三子卷积层。

[0103]

上述实施例提供的人脸活体检测方案中,通过样本图像集训练两个编解码重建模

型,使得第一编解码重建模型学习到人脸彩色图像的图像特征所对应的人脸红外图像的图像特征,使得第二编解码重建模型学习到人脸彩色图像的图像特征所对应的人脸深度图像的图像特征,从而根据待检测的人脸彩色图像重建出人脸红外图像和人脸深度图像,然后将人脸彩色图像和重建的人脸红外图像、人脸深度图像输入多模态的网络模型,多模态的网络模型对人脸的彩色图像特征、红外图像特征和深度图像特征进行融合,相比于仅基于彩色图像的人脸活体检测,能够降低对光线的敏感度,大大提高检测准确率,且提高网络的泛化能力,从而提高对照片、视频等平面攻击的防御效果,同样提高了对于未知攻击样本的防御效果。

[0104]

并且,在检测过程中,仅利用人脸彩色图像即可进行人脸活体的多模态融合检测,也就是说,根据一张人脸彩色图像即可进行多模态的人脸活体检测,不需要再采集人脸红外图像和人脸深度图像。

[0105]

本公开的技术方案中,所涉及的用户个人信息的获取,存储和应用等,均符合相关法律法规的规定,且不违背公序良俗。

[0106]

根据本公开的实施例,本公开还提供了一种电子设备、一种可读存储介质和一种计算机程序产品。

[0107]

本公开提供了一种电子设备,包括:

[0108]

至少一个处理器;以及

[0109]

与所述至少一个处理器通信连接的存储器;其中,

[0110]

所述存储器存储有可被所述至少一个处理器执行的指令,所述指令被所述至少一个处理器执行,以使所述至少一个处理器能够执行人脸活体检测方法。

[0111]

本公开提供了一种存储有计算机指令的非瞬时计算机可读存储介质,其中,所述计算机指令用于使所述计算机执行人脸活体检测方法。

[0112]

本公开提供了一种计算机程序产品,包括计算机程序,所述计算机程序在被处理器执行时实现人脸活体检测方法。

[0113]

图5示出了可以用来实施本公开的实施例的示例电子设备500的示意性框图。电子设备旨在表示各种形式的数字计算机,诸如,膝上型计算机、台式计算机、工作台、个人数字助理、服务器、刀片式服务器、大型计算机、和其它适合的计算机。电子设备还可以表示各种形式的移动装置,诸如,个人数字处理、蜂窝电话、智能电话、可穿戴设备和其它类似的计算装置。本文所示的部件、它们的连接和关系、以及它们的功能仅仅作为示例,并且不意在限制本文中描述的和/或者要求的本公开的实现。

[0114]

如图5所示,设备500包括计算单元501,其可以根据存储在只读存储器(rom)502中的计算机程序或者从存储单元508加载到随机访问存储器(ram)503中的计算机程序,来执行各种适当的动作和处理。在ram 503中,还可存储设备500操作所需的各种程序和数据。计算单元501、rom 502以及ram 503通过总线504彼此相连。输入/输出(i/o)接口505也连接至总线504。

[0115]

设备500中的多个部件连接至i/o接口505,包括:输入单元506,例如键盘、鼠标等;输出单元507,例如各种类型的显示器、扬声器等;存储单元508,例如磁盘、光盘等;以及通信单元509,例如网卡、调制解调器、无线通信收发机等。通信单元509允许设备500通过诸如因特网的计算机网络和/或各种电信网络与其他设备交换信息/数据。

[0116]

计算单元501可以是各种具有处理和计算能力的通用和/或专用处理组件。计算单元501的一些示例包括但不限于中央处理单元(cpu)、图形处理单元(gpu)、各种专用的人工智能(ai)计算芯片、各种运行机器学习模型算法的计算单元、数字信号处理器(dsp)、以及任何适当的处理器、控制器、微控制器等。计算单元501执行上文所描述的各个方法和处理,例如人脸活体检测方法。例如,在一些实施例中,人脸活体检测方法可被实现为计算机软件程序,其被有形地包含于机器可读介质,例如存储单元508。在一些实施例中,计算机程序的部分或者全部可以经由rom 502和/或通信单元509而被载入和/或安装到设备500上。当计算机程序加载到ram 503并由计算单元501执行时,可以执行上文描述的人脸活体检测方法的一个或多个步骤。备选地,在其他实施例中,计算单元501可以通过其他任何适当的方式(例如,借助于固件)而被配置为执行人脸活体检测方法。

[0117]

本文中以上描述的系统和技术的各种实施方式可以在数字电子电路系统、集成电路系统、场可编程门阵列(fpga)、专用集成电路(asic)、专用标准产品(assp)、芯片上系统的系统(soc)、负载可编程逻辑设备(cpld)、计算机硬件、固件、软件、和/或它们的组合中实现。这些各种实施方式可以包括:实施在一个或者多个计算机程序中,该一个或者多个计算机程序可在包括至少一个可编程处理器的可编程系统上执行和/或解释,该可编程处理器可以是专用或者通用可编程处理器,可以从存储系统、至少一个输入装置、和至少一个输出装置接收数据和指令,并且将数据和指令传输至该存储系统、该至少一个输入装置、和该至少一个输出装置。

[0118]

用于实施本公开的方法的程序代码可以采用一个或多个编程语言的任何组合来编写。这些程序代码可以提供给通用计算机、专用计算机或其他可编程数据处理装置的处理器或控制器,使得程序代码当由处理器或控制器执行时使流程图和/或框图中所规定的功能/操作被实施。程序代码可以完全在机器上执行、部分地在机器上执行,作为独立软件包部分地在机器上执行且部分地在远程机器上执行或完全在远程机器或服务器上执行。

[0119]

在本公开的上下文中,机器可读介质可以是有形的介质,其可以包含或存储以供指令执行系统、装置或设备使用或与指令执行系统、装置或设备结合地使用的程序。机器可读介质可以是机器可读信号介质或机器可读储存介质。机器可读介质可以包括但不限于电子的、磁性的、光学的、电磁的、红外的、或半导体系统、装置或设备,或者上述内容的任何合适组合。机器可读存储介质的更具体示例会包括基于一个或多个线的电气连接、便携式计算机盘、硬盘、随机存取存储器(ram)、只读存储器(rom)、可擦除可编程只读存储器(eprom或快闪存储器)、光纤、便捷式紧凑盘只读存储器(cd

‑

rom)、光学储存设备、磁储存设备、或上述内容的任何合适组合。

[0120]

为了提供与用户的交互,可以在计算机上实施此处描述的系统和技术,该计算机具有:用于向用户显示信息的显示装置(例如,crt(阴极射线管)或者lcd(液晶显示器)监视器);以及键盘和指向装置(例如,鼠标或者轨迹球),用户可以通过该键盘和该指向装置来将输入提供给计算机。其它种类的装置还可以用于提供与用户的交互;例如,提供给用户的反馈可以是任何形式的传感反馈(例如,视觉反馈、听觉反馈、或者触觉反馈);并且可以用任何形式(包括声输入、语音输入或者、触觉输入)来接收来自用户的输入。

[0121]

可以将此处描述的系统和技术实施在包括后台部件的计算系统(例如,作为数据服务器)、或者包括中间件部件的计算系统(例如,应用服务器)、或者包括前端部件的计算

系统(例如,具有图形用户界面或者网络浏览器的用户计算机,用户可以通过该图形用户界面或者该网络浏览器来与此处描述的系统和技术的实施方式交互)、或者包括这种后台部件、中间件部件、或者前端部件的任何组合的计算系统中。可以通过任何形式或者介质的数字数据通信(例如,通信网络)来将系统的部件相互连接。通信网络的示例包括:局域网(lan)、广域网(wan)和互联网。

[0122]

计算机系统可以包括客户端和服务器。客户端和服务器一般远离彼此并且通常通过通信网络进行交互。通过在相应的计算机上运行并且彼此具有客户端

‑

服务器关系的计算机程序来产生客户端和服务器的关系。服务器可以是云服务器,也可以为分布式系统的服务器,或者是结合了区块链的服务器。

[0123]

应该理解,可以使用上面所示的各种形式的流程,重新排序、增加或删除步骤。例如,本发公开中记载的各步骤可以并行地执行也可以顺序地执行也可以不同的次序执行,只要能够实现本公开公开的技术方案所期望的结果,本文在此不进行限制。

[0124]

上述具体实施方式,并不构成对本公开保护范围的限制。本领域技术人员应该明白的是,根据设计要求和其他因素,可以进行各种修改、组合、子组合和替代。任何在本公开的精神和原则之内所作的修改、等同替换和改进等,均应包含在本公开保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1