一种多无人机搜索过程中的多目标感知融合方法

本发明属于多无人机协同态势感知,特别是涉及一种多无人机搜索过程中的多目标感知融合方法。

背景技术:

1、近年来,随着科学技术的发展,无人机凭借其低成本、高灵活性和操控简单等特点,已被广泛应用于生活中的各种行业。无人飞行器与有人飞行器相比体积更小、经济成本更低且没有人员伤亡风险,故其往往更适合于危险环境或不适合人员直接靠近的环境之中。利用无人机进行目标搜索是无人机的典型应用场景,目前该工作主要由人工手动操控并目视观察,在大范围搜索过程中需要较高的人力成本,作业效率较低,并且当目标较多且区分度不高时,难以对大量重复目标进行匹配合并,最终对接下来的决策过程造成困难。

2、在进行多无人机协同搜索与感知融合任务时,多目标的融合过程与无人机感知测量结果息息相关,在传统融合算法中,多目标融合往往需要准确的目标位置与速度等信息,但无人机测量过程噪声较大,当目标运动速度较低且相互距离较近时,较低的信噪比将使得传统融合算法在匹配过程中难以获得准确的相似性判断条件,故难以对此类目标进行关联匹配,难以对错误的关联匹配进行甄别。因此,多无人机协同搜索与感知融合任务需要一种统一且连贯的方法,针对不同噪声类型下目标解算位置仍保持较高形状相似性的特点,不过分依赖目标解算位置的绝对数值大小,而使用相邻判断与形状匹配情况作为相似性判断条件,并充分考虑从感知到融合过程中各环节的相互影响,实现一种有效、连续的感知融合方法,避免了使用传统方法可能出现的问题。

技术实现思路

1、本发明目的在于解决上述背景技术中提出的问题,实现多无人机目标搜索过程中多机多视角对大场景中多目标信息的感知融合。因此提出一种多无人机搜索过程中的多目标感知融合方法,应对在多无人机协同搜索任务中,实现由多无人机实时获取目标位置、实时在多无人机间完成多目标融合,并生成融合目标池,为后续决策过程提供场景多目标信息参考。

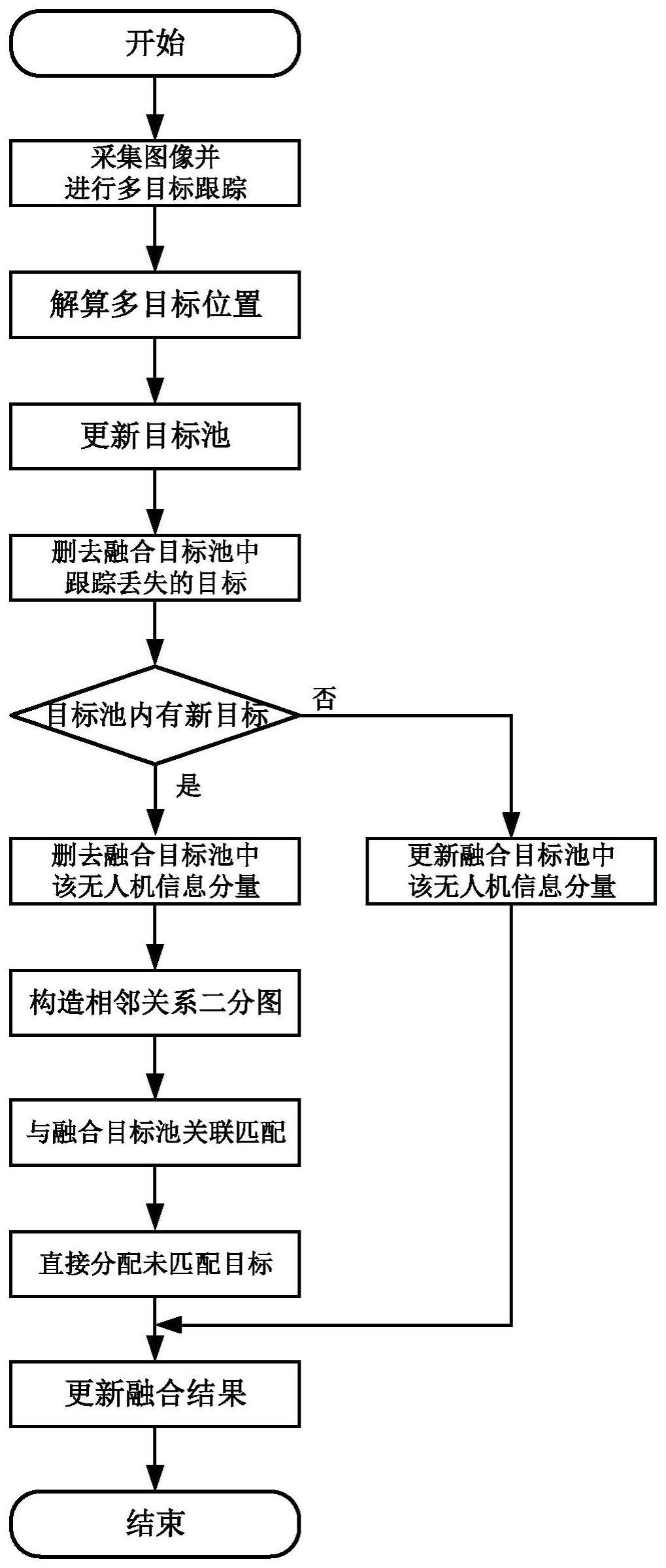

2、为了实现本发明目的,本发明公开了一种多无人机搜索过程中的多目标感知融合方法,包括以下步骤:

3、步骤1、单无人机a采集机载相机图像,并对给定搜索目标进行多目标跟踪,得到多目标图像位置和跟踪编号;

4、步骤2、由多目标图像位置和相机位姿信息,解算出多目标在世界坐标系中位置;

5、步骤3、使用步骤1、2中的结果,更新无人机a的目标池信息,并发送至融合目标池;

6、步骤4、删去融合目标池中跟踪丢失的目标;

7、步骤5、若无人机a的目标池没有新目标出现,则对融合目标池中无人机a的信息分量进行更新,并转到步骤10;若有新目标出现,则从融合目标池中删除当前无人机的多目标信息,并重新进行匹配融合;

8、步骤6、删去融合目标池中无人机a的信息分量,得到待匹配的融合目标池子集和无人机a待匹配的目标池子集;

9、步骤7、对待匹配的融合目标池子集和无人机a待匹配的目标池子集中各目标依次判断相邻关系,并构造相邻关系二分图;

10、步骤8、简化相邻关系二分图,并以最大匹配数和最小形状差距作为关联度量进行关联匹配;

11、步骤9、将无人机a目标池中未被关联的目标直接分配为新的融合目标;

12、步骤10、更新融合目标池中各目标的位置信息,得到由无人机a更新后的多目标融合结果,重复执行上述步骤即能够得到由多无人机获得的多目标融合结果。

13、进一步地,步骤1中使用多目标跟踪算法对采集到的图像进行多目标检测与跟踪,其中,采集设备分辨率为1920x1080,检测使用yolo(you only look once,你只看一次)算法检测出图像中给定搜索目标的像素位置,跟踪使用简单在线实时跟踪sort(simpleonline and realtime tracking)多目标跟踪算法对检测结果进行数据关联,最终获得多目标在无人机a采集图像中的像素位置和对应分配的跟踪编号。

14、进一步地,步骤2中对目标像素位置和相机位姿信息进行目标位置解算,其中相机装置于增稳云台上并挂载在无人机下方,具体包括以下步骤:

15、步骤2-1、由目标像素位置获取相机前方归一化图像平面上投影点在世界坐标系中的位置(xw,yw,zw),其投影公式为:

16、

17、其中(u,v)为目标在去除畸变后图像中的像素坐标,其值为目标中心距图像左上角的横向、纵向像素个数,d为归一化图像平面与相机间的距离深度,k为相机的内参矩阵,xw,yw,zw)为投影点在世界坐标系中的位置,为相机的外参矩阵,其值等价于相机姿态矩阵的逆矩阵,具体为:

18、

19、其中rc为相机旋转至当前姿态所对应的旋转矩阵,c为相机在世界坐标系中的位置列向量,结合上述两式,则(xw,yw,zw)由下式直接获得:

20、

21、其中d为1m,rc由云台及无人机机体姿态获得,c为无人机位置,具体为由gps获得的位置与坐标原点的相对位置;

22、步骤2-2、以相机世界坐标系中的位置为起点,通过步骤2-1求得的投影点(xw,yw,zw),构造射线并与地平面相交,设定地平面高度为0m,则该目标在地平面的投影点在世界坐标系中x、y方向上的位置由下式获得:

23、

24、其中(x,y,z)为相机在世界坐标系中的位置;

25、步骤2-3、重复步骤2-1直到图像中所有目标均完成位置解算,最终获得多目标在世界坐标系中位置。

26、进一步地,步骤3中对无人机a目标池进行更新,其中无人机a目标池是指包含无人机a所搜索到目标的集合,包括目标位置、位置解算方差、跟踪编号和时间戳信息,其更新过程具体包括以下步骤:

27、步骤3-1、构造无人机a新目标池,其内容由步骤1和步骤2获得多目标在世界坐标系中位置、跟踪编号及当前时间戳;

28、步骤3-2、记录跟踪编号出现在旧目标池中但不在新目标池中的目标,作为无人机a当前搜索过程中的丢失目标,并从新目标池中删去;

29、步骤3-3、记录跟踪编号出现在新目标池中但不在旧目标池中的目标,删去其中不符合起始条件的目标,并将剩余目标作为无人机a当前搜索过程中的新捕获目标,其具体过程为:

30、步骤3-3-1、在搜索过程开始前,构造一个用于记录跟踪编号和时间戳的空列表;

31、步骤3-3-2、遍历列表并删除未在新目标池中出现的跟踪编号及其对应的时间戳;

32、步骤3-3-3、遍历列表并比较列表中记录的时间戳与当前时间戳的持续时间,若持续时间大于设定的阈值,则删除该时间戳及其对应的跟踪编号,同时标记当前时刻无人机捕获到新目标,否则从新目标池中删去对应跟踪编号的目标;

33、步骤3-3-4、遍历新目标池并向列表中添加跟踪编号不在列表内的目标对应的跟踪编号及当前时间戳;

34、步骤3-4、将新目标池作为当前无人机a目标池,完成一次无人机目标池更新,并根据目标池中目标距无人机的距离,估计各目标位置解算方差σ2并作为相邻判断依据,具体含义为,根据3σ准则,在当前状态下解算得到的该目标位置,与该目标实际位置的欧式距离不大于3σ,其中σ值由下式获得:

35、

36、其中,σe为目标距无人机直线距离le时位置解算误差的标准差,ke为该标准差随目标距无人机直线距离的变化系数,l为无人机距目标解算三维坐标的直线距离。

37、进一步地,步骤4中融合目标池是指包含由多个无人机目标感知结果融合得到的融合目标的集合,融合目标包括关联集合、融合目标位置、融合目标位置方差、融合编号和时间戳信息,其中关联集合为被关联为该融合目标的各无人机目标池中对应目标的集合,融合目标位置与融合目标位置方差具体计算公式为:

38、

39、其中μi与分别为融合目标i的位置与方差,ji为融合目标i的关联集合,j∈ji为关联目标下标,μj与分别为关联目标j的位置与方差,该融合过程类似于对多个服从正态分布的位置信息进行乘积叠加;

40、在步骤4中,若某融合目标的关联集合中仅包含无人机a的某一目标,且该目标是步骤3-2中的丢失目标,则删去该融合目标,遍历融合目标池,完成融合目标池的对跟踪丢失目标的删除。

41、进一步地,步骤5中针对若当前无人机目标池中没有新捕获目标的情况,此时直接对融合目标池中无人机a的信息分量进行更新,即更新融合目标池中与无人机a有关联的目标对应的目标位置、目标位置解算方差、时间戳信息,遍历融合目标池,完成融合目标池中无人的a息分量进行更新,并转到步骤10。

42、进一步地,步骤6中删去融合目标池中无人机a的信息分量,得到待匹配的融合目标池子集和无人机a待匹配的目标池子集,具体包括以下步骤:

43、步骤6-1、构造待匹配的融合目标池子集和无人机a待匹配的目标池子集;

44、步骤6-2、将无人机a目标池中全部目标填入无人机a待匹配的目标池子集中;

45、步骤6-3、遍历融合目标池,若某融合目标的关联集合包含有来自无人机a的目标,且该融合目标的关联集合中的关联个数大于1,则从关联集合中删去来自无人机a的关联并重新计算该融合目标的位置与方差,并在待匹配的融合目标池子集中添加该融合目标,转到步骤6-5;

46、步骤6-4、若某融合目标的关联集合仅包含有来自无人机a的目标,则从无人机a待匹配的目标池子集中删去此来自无人机a的目标;

47、步骤6-5、重复步骤6-3,直至融合目标被全部遍历,得到最终待匹配的融合目标池子集和无人机a待匹配的目标池子集。

48、进一步地,步骤7中采用相邻关系判断构造了一个相邻关系二分图,具体包含以下步骤:

49、步骤7-1、构造空二分图g=(x,y),其中x存放来自无人机a待匹配目标池子集中的目标,y存放来自待匹配融合目标池子集中的目标;

50、步骤7-2、从无人机a待匹配的目标池子集中取出一个目标;

51、步骤7-3、遍历融合目标池,若该目标与待匹配融合目标池子集中目标满足相邻关系,则将该目标加入x中、将有相邻关系的融合目标加入y中,若已加入y中则忽略,同时在g中连接目标与所有具有相邻关系的融合目标,其中相邻关系判断方式为:

52、

53、其中xi,yi,σi为融合目标i的位置和标准差,x,y,σ为该目标的位置和标准差;

54、步骤7-4、重复步骤7-2,直到无人机a待匹配的目标池子集中的目标均被取出,得到最终的二分图g。

55、进一步地,步骤8中对步骤7得到的二分图进行简化并按照最大匹配原则进行形状匹配,构造无人机a目标池目标与融合目标池中融合目标的关联,具体包括以下步骤:

56、步骤8-1、构造空二分图g′=(xn,y′),其中x′存放来自x中的目标,y′存放来自y中的目标;

57、步骤8-2、构造空集合s记录下一次寻找的目标,并从二分图g的x集合中选择一个目标放入s中,若x集合为空集则算法结束;

58、步骤8-3、在二分图g的x集合中寻找s中的全部目标,从二分图g的y集合中选择与之连接的全部融合目标作为新的集合s,并将寻找得到的全部目标从x中移至x′中,若s为空集则转到步骤8-5;

59、步骤8-4、在二分图g的y集合中寻找s中的全部融合目标,从二分图g的x集合中选择与之连接的全部目标作为新的集合s,并将寻找得到的全部融合目标从y中移至yn中,若s不为空集则转到步骤8-3;

60、步骤8-5、用匈牙利算法获得二分图g′的最大配对数n,若n为0则转到步骤8-2;

61、步骤8-6、遍历全部g′中配对数为n的配对,按最小形状差距作为关联度量选择一组配对作为无人机目标池中目标与融合目标池中融合目标的匹配关系,其中形状差距具体定义为:

62、

63、

64、其中和eshape为该组配对的整体偏移误差向量和形状差距,m为该组配对中位于二分图g′的x′集合中对应的目标集合,f(·)为该组配对的匹配映射关系,xm和ym为目标m的解算位置x和y,xf(m)和yf(m)为与目标m配对的对应融合目标的位置x和y,λ为偏移误差影响系数;

65、步骤8-7、根据步骤8-6得到的配对,将无人机a目标池中目标关联到与之配对的融合目标池中的目标,若x集合为空集则算法结束,否则转到步骤8-1。

66、进一步地,步骤9中将无人机a目标池中所有未与融合目标池中融合目标发生关联的目标直接分配为新的融合目标,并添加到融合目标池中,并在步骤10中重新计算融合目标池中各融合目标的位置与方差,得到由无人机a更新后的多目标融合结果,对其他无人机b、c…重复执行上述步骤即能够得到由多无人机连续更新而获得的多目标融合结果。

67、与现有技术相比,本发明的显著进步在于:1)本发明是一种多无人机搜索过程的多目标感知融合方法,典型使用场景为多无人机俯视搜索多移动目标,可根据无人机搜索结果自动生成融合结果,并实时反应真实目标的位置与移动状态;2)本发明在局部多无人机视野发生重叠的区域内,通过相邻判断与形状匹配,避免了传统融合算法中对低速、聚集目标匹配困难的问题;3)本发明可连续运行,对无人机更新搜索结果的顺序不敏感,且无需指定搜索无人机数量与目标数量。

68、为更清楚说明本发明的功能特性以及结构参数,下面结合附图及具体实施方式进一步说明。

- 还没有人留言评论。精彩留言会获得点赞!