具有鲁棒性的立体摄像装置图像处理方法和系统与流程

本发明涉及一种从立体摄像装置图像对中提取视差信息的方法和系统,可用于例如处理车辆中的自动驾驶(ad)或高级驾驶员辅助系统(adas)的摄像传感器图像。

背景技术:

1、汽车应用使用了立体摄像装置,例如ep 3176750 a1中展示了用于机动车辆的一立体成像系统和处理系统。所述系统设计用于执行立体图像的校正以及经校正图像的立体匹配,并从经匹配的立体图像中检测机动车辆周围环境中的对象。数据处理装置设计用于,对一成像装置经校正图像的图像元素进行搜索,在来自另一成像装置相应的经校正图像中寻找最佳匹配的图像元素,其中,所述搜索覆盖一个二维搜索区域。搜索产生垂直位移信息,从中得出从图像元素到经最佳匹配的图像元素的垂直位移。数据处理装置设计用于,从垂直偏移信息中计算出成像装置的或成像装置之间的俯仰角误差和/或滚动角误差。

2、典型的立体摄像装置系统在匹配处理前需要进行图像校正。这通常出于实际原因,以减少(例如半全局匹配(sgm)等)匹配算法的复杂性。如果校正是在摄像装置水平线上进行的,那么视差的匹配就可减少到一维问题。

3、d.·克吕克尔(d.)等人在2018年sia vision大会论文集中发表了论文:

4、“camera based lost cargo detection for automated driving(基于摄像装置的自动驾驶物品丢失检测)”,其中展示了一种基于摄像装置的方法,所述方法依靠两个不同卫星立体摄像装置系统,通过直接的三维(3d)测量提取道路上的小障碍物。其中,一个卫星立体摄像模块是一长焦摄像装置。

5、de 102020214622 a1涉及一种评估立体摄像装置图像数据的方法和装置。评估立体摄像装置图像数据的方法包括以下步骤:

6、a)接收由立体摄像装置拍摄的原始分辨率的图像数据,

7、b)接收或计算具有降低的分辨率的图像数据,

8、c)从立体摄像装置的摄像模块的二维(2d)图像数据中检测对象,

9、d)在包含检测到的对象的图像数据搜索区域中以原始分辨率进行立体评估,并在图像数据的其余区域中以经降低的分辨率进行立体评估,以确定相关对象和周围环境的三维(3d)信息,以及

10、e)输出相关三维(3d)信息。

11、对具有镜头畸变的高分辨率摄像装置进行校正的计算工作量会很大,并会扩大所产生的“线性化”图像尺寸。在校正步骤中,需要在像素之间进行插值。由此就模糊了像素信息。此外,一些区域的分辨率提高了,却没增加更多的信息。在一些区域分辨率降低,并且信息被丢弃。

技术实现思路

1、本发明的目的是提供一种具有鲁棒性的立体图像处理方法。

2、它一方面涉及的是高级辅助驾驶或自主驾驶所需的汽车功能。

3、自主车辆需要检测车辆前方的障碍物。立体摄像装置的优点是可测量对象的深度和距离。

4、典型的立体摄像装置由2个观察同一方向的摄像装置组成。通过匹配左边和右边的图像,计算出与对象深度有关的视差。一种作为替代选择的立体摄像装置由移动的单目摄像装置组成,这通常是驾驶车辆中的单目摄像装置的情况。从先后连续的时间点拍摄到的图像对(或图像序列)中,可提取周围环境的结构信息(“运动恢复结构”)。

5、所提出方法可用于二维(2d)/三维(3d)对象检测、二维(2d)/三维(3d)对象追踪、三维(3d)场景重建、三维(3d)制图、三维(3d)周围环境模型(例如通过摄像装置图像与雷达传感器/激光传感器融合获取)、物品丢失检测、对象检测、三维(3d)道路表面建模和/或基于增强现实(ar)的可视化。

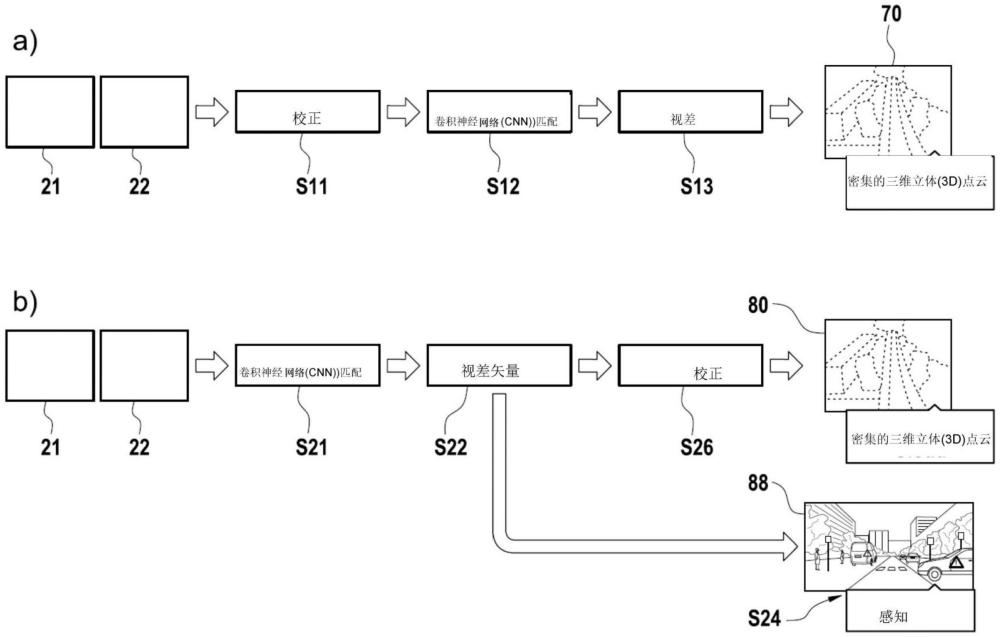

6、从立体摄像装置图像对中提取视差信息的方法包括以下步骤:

7、a)接收未经校正的立体摄像装置图像对,

8、b)使用经训练的卷积神经网络对所接收图像对进行二维(2d)匹配,提供逐个像素的二维(2d)位移作为视差信息,以及

9、c)输出像素级的二维(2d)位移。

10、卷积神经网络可能已经过训练,使用监督学习方法从未经校正的立体摄像装置图像对中生成每个像素的二维(2d)位移图。

11、根据一实施方式所述,二维(2d)位移被描述为视差矢量。

12、在一示例中,二维(2d)位移信息被用作如对象检测或诸如此类后续感知任务的输入。

13、根据一实施方式所述,二维(2d)位移的方向随时间的推移被积累,为图像像素位置提供一经过滤的角度方向。经过滤的角度方向对应于该特定图像像素位置的极线方向。

14、在一示例中,立体摄像系统的基本矩阵参数是由未经校正的逐个像素视差计算得出的。

15、根据一实施方式所述,二维(2d)位移用于摄像装置外部参数的视差校正。摄像装置内部参数可从最初的摄像装置校准过程中获知。

16、在一示例中,以米为单位的三维(3d)真实世界坐标是根据二维(2d)位移计算得到的。摄像装置内部参数可以是已知的或估计得到的,以用于计算真实距离。

17、根据一实施方式所述,二维(2d)位移被用于计算密集的三维(3d)点云。

18、用于从一立体摄像装置图像对提取视差信息的系统包括输入单元、处理单元和输出单元。

19、a)输入单元配置为,接收未经校正的立体摄像装置图像对。

20、b)处理单元配置为,使用经训练的卷积神经网络对所接收图像对进行二维(2d)匹配,提供逐个像素层的二维(2d)位移作为视差信息。

21、c)输出单元配置为,在像素层上输出二维(2d)位移。

22、另一方面涉及一种包括用于提取视差信息的系统和立体摄像系统的车辆。立体摄像系统配置为,生成未经校正的立体摄像图像对,并将其输出到用于提取视差信息的系统。.

23、所提出系统的优点是具有鲁棒性,无需高精度校正。与现有技术相比,在匹配过程后对视差值进行校正,可降低算法复杂性,同时保留所有信息。

24、换句话说,所提出解决方案使用立体摄像装置系统,它提供图像(强度、红黄蓝三原色(rgb)、拜耳(bayer)原图(未经马赛克处理)......)和描述左右图像中两个相应像素之间位移的视差图。所提出的系统在计算视差前无需校正。视差计算通常包括对左、右图像进行逐个像素的匹配。使用所提出的匹配过程可计算二维(2d)位移。由此产生的位移被逐个像素地描述为二维(2d)矢量(x维度和y维度的位移)。我们应用一可训练的神经网络进行匹配,所述神经网络是用移位和旋转图像进行训练的。也可使用(例如块匹配等)其他二维(2d)匹配算法。为提取真正的深度信息,必须考虑摄像装置内部参数。这就导致了匹配后对视差图的校正。因此,二维(2d)图像的视差被用来计算世界坐标系/车辆坐标系的三维(3d)点测量结果。

25、-随着时间的推移,累积经校正的视差测量值

26、将视差匹配应用于原始(失真和未经校正的)图像后,二维(2d)视差矢量的方向将随着时间的推移而累积,从而产生一经过滤的角度方向,相当于该特定图像像素位置的极线方向。

- 还没有人留言评论。精彩留言会获得点赞!